이진 인코딩을 소개하는 포스팅을 시작하겠습니다. 바이너리 인코딩부터 시작하겠습니다. 빵은 1 번, 요구르트는 2 번, 머핀은 3 번, 2 진수로 지정하면 이 숫자를 바꾼 값을 의미합니다. 이진수 1로 이진수는 01. 그래서 빵은 01이고 2는 10이됩니다 그래서 요구르트는 10이 될 것입니다. 3의 이진수는 11이 될 것입니다. 그래서 머핀은 11이 됩니다.

프로세스의 다음 단계는 다시 나누는 것입니다. 마치 첫 번째 변수에 대해 두 개의 새로운 변수를 만드는 것처럼 서로 다른 열로 표시해야 합니다. 빵은 0, 요구르트는 1, 머핀은 2인 것을 기억해야 합니다.

빵이 3개 있으면 11이 되어 머핀으로 인코딩 되지 않도록 유의해야 합니다. 빵시 3개가 되어 머핀이 될 수 없으므로, 이러한 상관관계를 유의해서 인코딩을 진행해야 합니다.

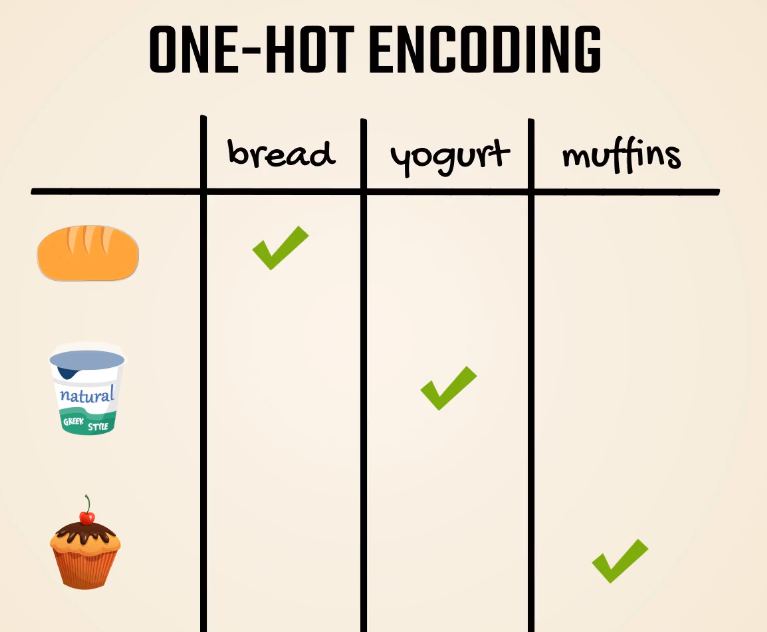

원핫 인코딩은 매우 간단하고 널리 채택되고 있으며 가능한 한 많은 열을 생성하는 것으로 구성되어 있습니다. 여기에 세 개의 제품이 있으므로 세 개의 열 또는 세 개의 변수가 필요합니다. 빵 요거트와 머핀이라고 부르도록 하겠습니다.

이 변수에 대해 상상해보십시오. 이 제품은 빵입니다. 이 제품은 요구르트이고 이 제품은 머핀입니다.

빵인 제품의 경우 100, 요구르트 010인 제품과 머핀인 제품의 경우 001을 갖게됩니다. 001 이것은 한 제품이 동시에 한 가지 유형 만 될 수 있기 때문에 매우 직관적입니다. 따라서 하나의 값 1 만 있고 나머지는 모두 0이 될 것입니다. 즉, 제품이 서로 관련이 없고 명확하지 않은 경우 활용됩니다.

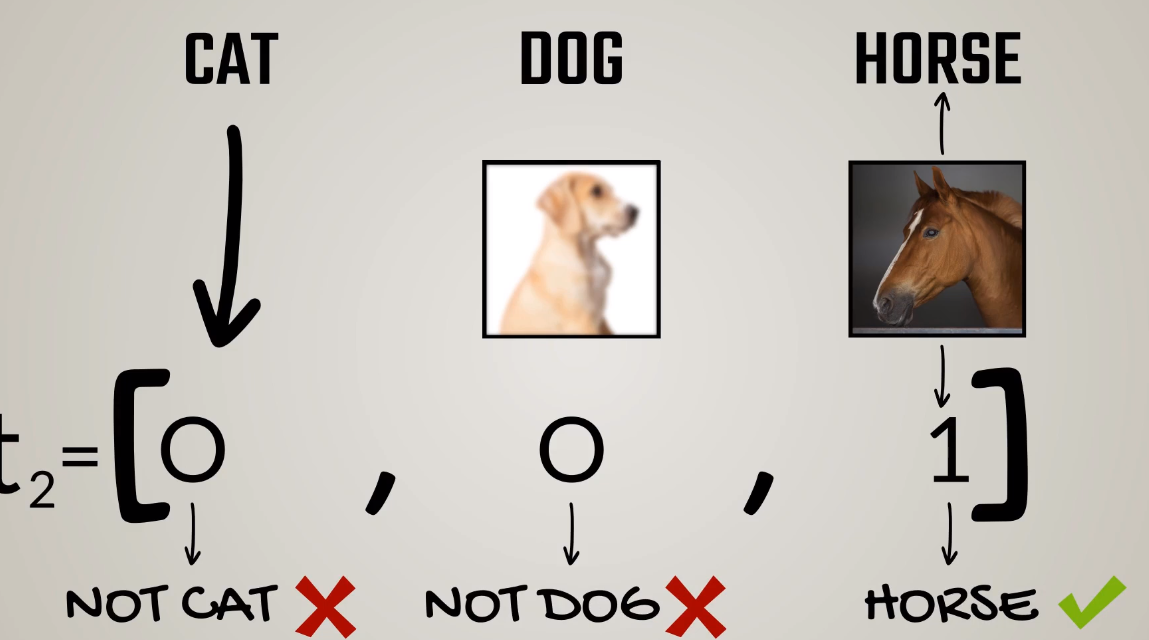

많은 튜토리얼 전에는 고양이 개와 말 분류에 대해 이야기 했었습니다. 대상 벡터는 하나에 인코딩되어 있었기 때문에 동일한 유형의 벡터를 사용했습니다. 한 번의 인코딩이지만 하나의 높은 인코딩에는 큰 문제가 하나 있습니다. 많은 새로운 변수가 필요합니다.

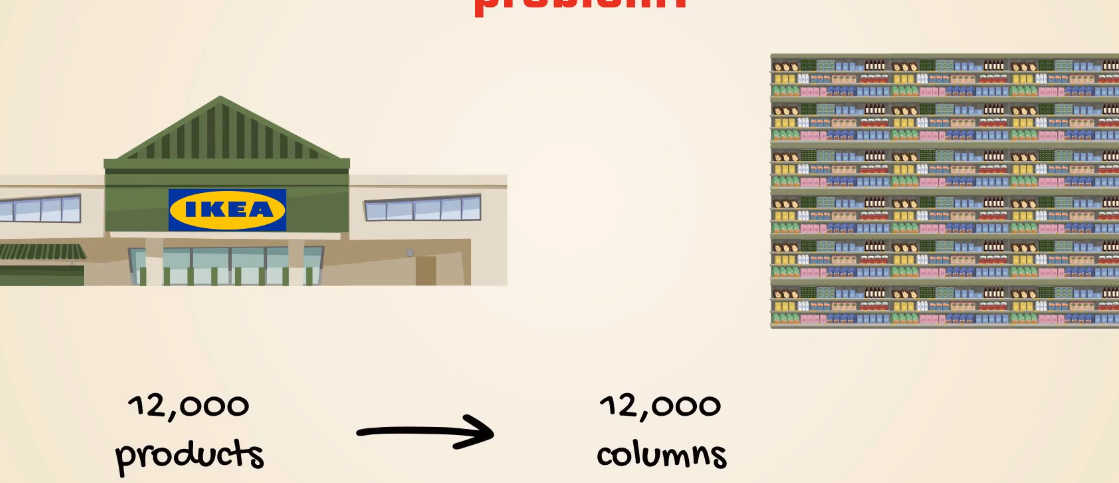

예를 들어 Ikea는 약 천개의 제품을 제공합니다. 입력에 12000개의 열이 필요합니다. 확실히 바이너리를 사용한다면, 12000개의 제품이 16개의 열로만 표현됩니다. 이것은 원핫 인코딩에 필요한 12000개 열보다 기하 급수적으로 낮습니다.

이러한 경우 제품간에 정당하지 않은 상관 관계가 발생하더라도 이진 인코딩을 사용해야합니다. 이진 인코딩과 선호하는 인코딩 사이에는 트레이드 오프가 있습니다. 여러 카테고리를 다룰 때 카테고리와 바이너리가 적을 때는 원핫 인코딩을 활용하면 좋습니다.

'SW > 딥러닝' 카테고리의 다른 글

| 43. 딥러닝 : MNIST 분류 예제 : 패키지 임포트, 데이터 준비 (0) | 2020.09.04 |

|---|---|

| 42. 딥러닝 : MNIST : 무엇이고 왜 경험해보아야 하는가? (0) | 2020.09.03 |

| 40. 딥러닝 : Categorical Data (범주형 데이터) : 개념, 필요성, 종류 (0) | 2020.08.30 |

| 39. 딥러닝 : Standardization(정규화) : 개념, 종류, 컨셉 (0) | 2020.08.29 |

| 38. 딥러닝 : Basic Preprocessing (기본 전처리) : 개념, 사용, 예시 (0) | 2020.08.28 |