반응형

다시 한 번 더 깊이 파고 들어야 할 시점입니다. 이전 섹션 중 하나에서 심층 신경망을 살펴볼 계획입니다.

간단한 선형 회귀 모델을 훈련하는 방법을 보았습니다. 두 개의 입력과 단일 출력이 있습니다. 이 떄, 배운 선형 모델을 사용했습니다.

이 함수는 L2 뉴런 손실에 따라 몇 백 번의 데이터가 가장 적합합니다. 이제 대부분의 실제 생활에 적용하기 위해서는 선형 레이어를 조합해 더 나은 예측 인공지능이 필요합니다.

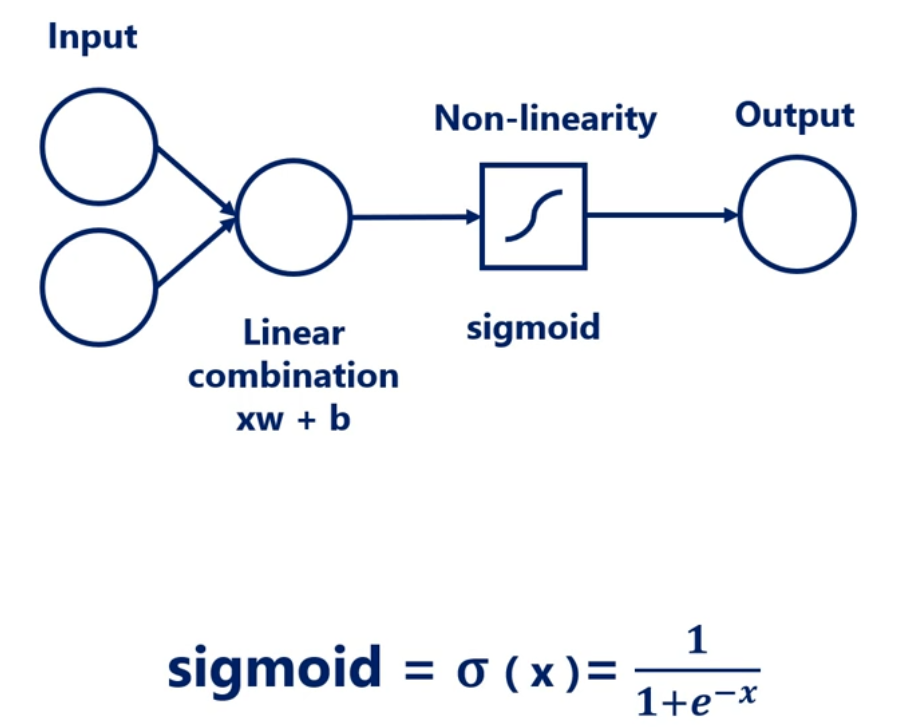

이것은 대부분 선형 모델보다 복잡한 모델로 작업하는 것을 의미합니다. 복잡함은 일반적으로 선형 혼합과 비선형 연산을 의미하며, 이러한 복잡성은 임의의 함수를 표현할 수 있게 합니다. 선형으로 결합된 입력에 출력을 할당한 다음 출력을 생성하는 비선형 변환을 수행하게 되는 것입니다.

아마도 비선형 성의 예를 보도록 하겠습니다. 위 시그모이드 함수의 식이 있습니다. 위 그림은 선형의 조합과 추가된 비선형성을 갖는 레이어가 하나 이상 있는 신경망의 빌딩 블록을 의미합니다. 이제 딥러닝에 대해 좀 더 깊이 있게 다가가 보도록 하겠습니다.

반응형

'SW > 딥러닝' 카테고리의 다른 글

| 15. 딥러닝 : 딥 뉴럴 네트워크 : 기본 구조 이해, 원리, 개념 (0) | 2020.03.03 |

|---|---|

| 14. 딥러닝 : 딥 뉴럴 네트워크 : 개념, 원리 : 파라미터, 하이퍼 파라미터 차이점 (0) | 2020.03.02 |

| 12. 딥러닝 : 텐서플로우 2.0 예제 : 결과 해석과 가중치와 바이어스 추출 (0) | 2020.02.29 |

| 11. 딥러닝 : 텐서플로우 2.0 : 기본 예제 : 코드 해석 (0) | 2020.02.28 |

| 28. 딥러닝 : 초기화(Initialization) : 개념, 방법, 필요성, 의문점 (0) | 2020.02.28 |