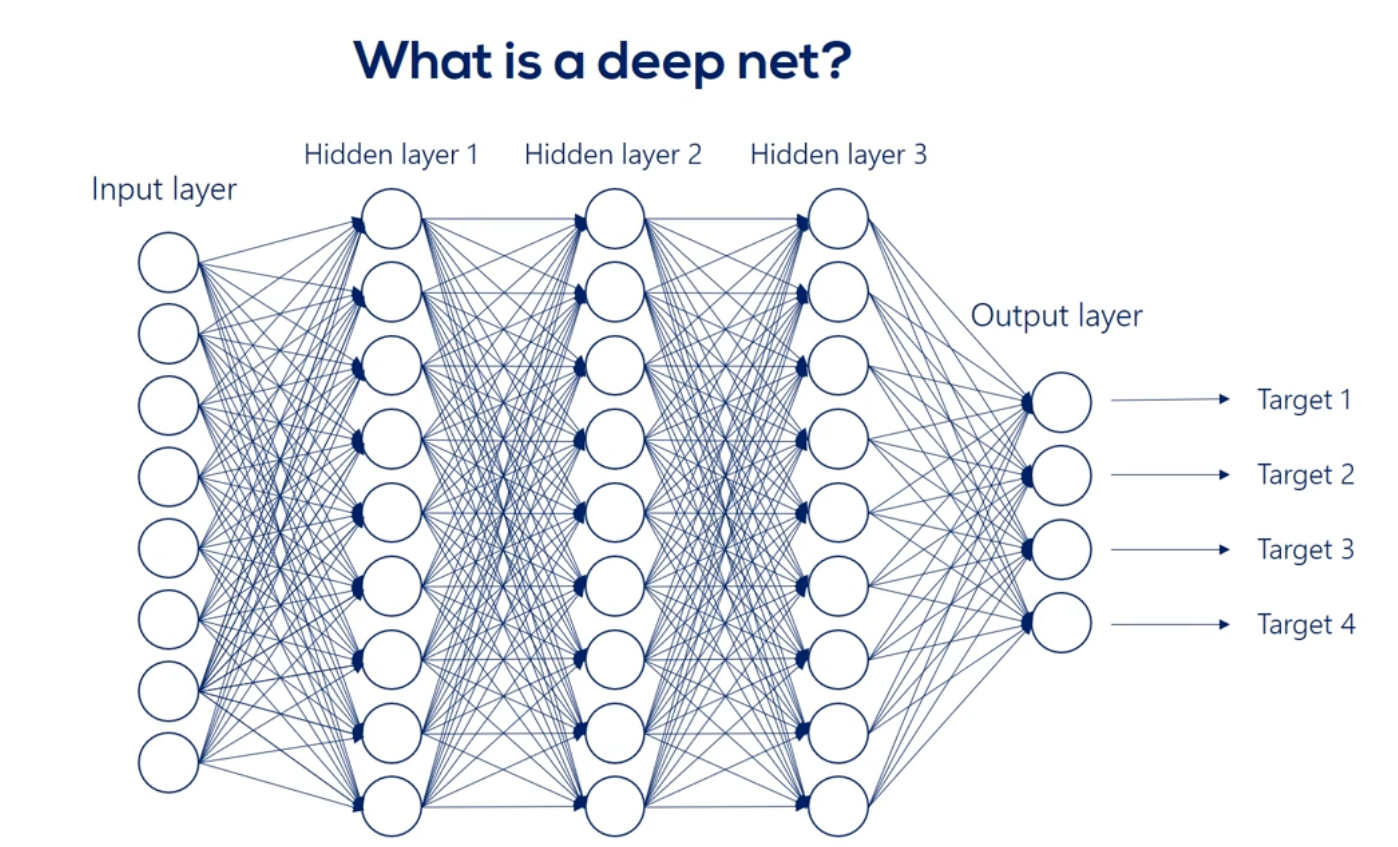

레이어에 대해 광범위하게 이야기 할 것이라고 약속했습니다. 딥 뉴럴 네트워크의 가장 일반적인 그림 표현은 위와 같습니다.

첫 번째 레이어는 입력 레이어라고합니다. 이것은 기본적으로 가지고있는 데이터입니다. 신경망의 기본 이론적 근거는 이제 이 출력을 다른 레이어의 입력으로 사용할 수 있고, 마지막 학습을 중지하기로 결정할 때, 그 레이어를 출력 레이어를 사용할 수 있다는 것입니다.

첫 번째 레이어는 입력 레이어이고 마지막 레이어는 출력 레이어입니다. 사이의 모든 레이어를 숨겨진 레이어라고합니다. 입력을 알고 출력을 얻지만 이러한 작업이 숨겨진 스태킹 계층마다 하나씩 딥 네트워크를 생성하거나 이를 딥넷이라고 하므로 어떻게되는지 알 수 없습니다. 숨겨진 계층의 빌딩 블록을 숨겨진 유닛 또는 노드라고 합니다.

숨겨진 레이어와 관련된 경우 수학 용어로 표시됩니다. 각 숨겨진 단위는 텐서의 요소입니다. 숨겨진 레이어의 숨겨진 단위 수는 일반적으로 레이어의 Width라고 하지만 항상 레이어를 쌓지는 않습니다.

깊이 있는 네트워크의 Width를 보았습니다. 깊이는 숨겨진 수를 나타내는 중요한 요소입니다. 기계 학습 알고리즘을 만들 때 Width와 Depth를 선택하면서 하이퍼 매개 변수를 매개 변수로 착각해서는 안됩니다.

파라미터는 가중치이고 바이어스의 하이퍼 매개 변수는 깊이, 학습 속도가 있음을 기억하십시오. 두 변수의 주요 차이점은 최적화를 시작하기 전에 매개 변수의 값이 최적화를 통해 도출되는 반면 하이퍼 매개 변수는 직접 설정한다는 것입니다.

다음 번에는 직접 코드로 적용해보도록 하겠습니다.

'SW > 딥러닝' 카테고리의 다른 글

| 16. 딥러닝 : 왜 딥러닝에는 비선형성이 필요한가? : 개념, 원리 (0) | 2020.03.04 |

|---|---|

| 15. 딥러닝 : 딥 뉴럴 네트워크 : 기본 구조 이해, 원리, 개념 (0) | 2020.03.03 |

| 13. 딥러닝 : 레이어 : 선형성과 비선형성 : 의미, 개념 (0) | 2020.03.01 |

| 12. 딥러닝 : 텐서플로우 2.0 예제 : 결과 해석과 가중치와 바이어스 추출 (0) | 2020.02.29 |

| 11. 딥러닝 : 텐서플로우 2.0 : 기본 예제 : 코드 해석 (0) | 2020.02.28 |