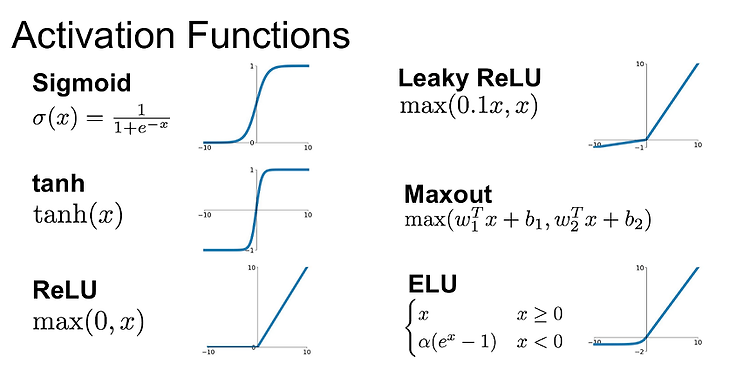

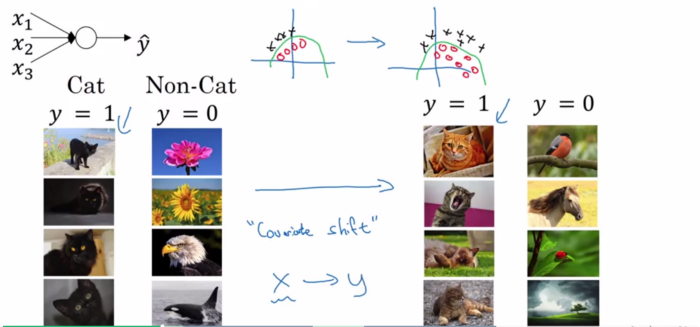

Activation 함수뉴런의 상호 작용을 담당합니다. 이러한 중요한 역할을 하는 Activation 함수들의 종류도 다양한 데 어떠한 것을 선택해야 할까요? 우선 주목해야 할 것은 비선형성입니다. 현실의 데이터는 n차원 비선형 분포로 존재합니다. 따라서 활성화 함수는 신경망에서 비선형 분포를 반영할 수 있도록 하는 역할을 담당합니다. 무엇이 좋은 activation 함수일까요? 이전에는 시그모이드 함수를 사용해왔습니다. 하지만 시그모이드 함수는 문제점이 존재하였고, 대책으로 좋은 RELU 활성화 함수가 제안되었습니다. One Hot EncodingN개의 Class를 가진 데이터의 Y Target 값을 설정할 때 One Hot Encoding을 사용합니다. N 사이즈의 배열에서 0, 1을 사용하여 해당하..